Власник Tesla мало не врізався в поїзд, що рухається, в режимі «автономного водіння» (4 фото + 1 відео)

Категорія: Електромобілі, PEGI 0+

22 травня 2024

Власник Tesla звинувачує режим Full Self Driving (FSD) - рух без керування кермом за заданим маршрутом - у тому, що його машина їхала у бік залізничних колій, якими в цей момент йшов склад. Водієві вдалося виправити ситуацію в останній момент. І він каже, що вже не вперше стикається з такими «закидонами» FSD.

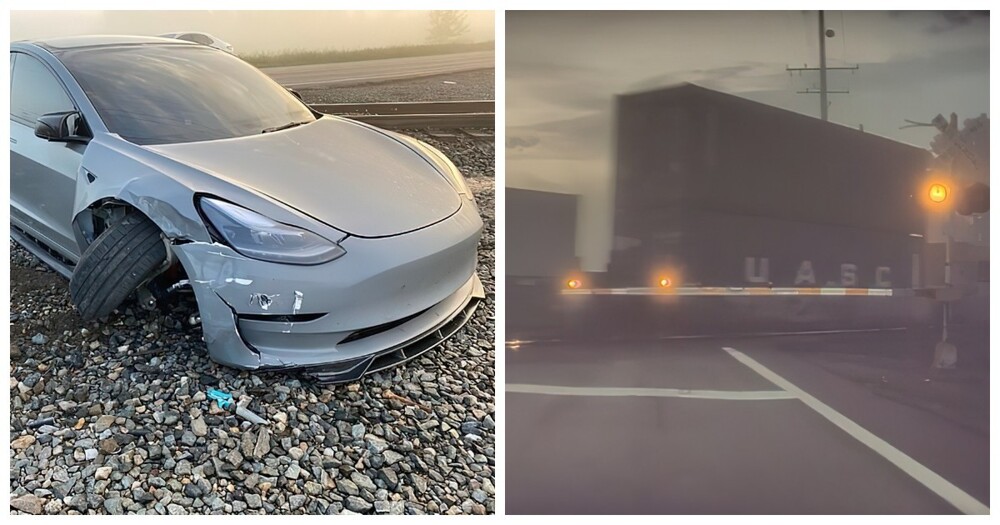

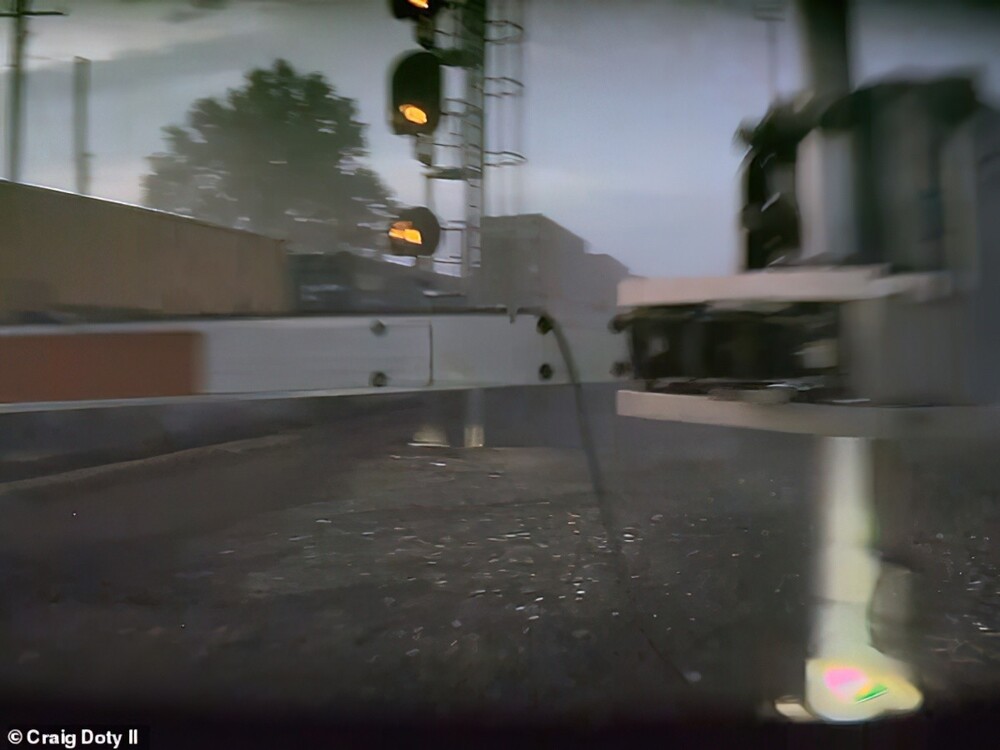

На записі з відеореєстратора видно, що машина в темряві і тумані швидко наближається до поїзда, що проходить, без ознак уповільнення.

Крейг Доті II з Огайо стверджує, що в той момент його автомобіль знаходився в режимі повного автономного водіння (FSD) і не зменшив швидкість, незважаючи на поїзд, що перетинає дорогу, але не уточнює марку або модель машини.

Водій встиг зреагувати і вирулити вправо, знісши шлагбаум на залізничному переїзді і зупинившись за кілька метрів від поїзда, що рухається.

Компанія Tesla зіткнулася з численними позовами, в яких стверджується, що функція FSD або Autopilot спричинила аварію — автомобіль або не зупинився перед іншим транспортним засобом, або звернув у бік об'єкта, що в деяких випадках забрало життя водіїв.

Автомобіль після зіткнення із шлагбаумом. Дякую, що не з поїздом

За даними Національної адміністрації безпеки дорожнього руху США (NHTSA), станом на квітень 2024 року системи автопілота Tesla моделей Y, X, S та 3 з 2019 року стали учасниками 17 смертельних випадків та 736 аварій.

Крейг Доті II повідомив про проблему на сайті Tesla Motors Club, заявивши, що володіє автомобілем менше року, але «за останні шість місяців він двічі намагався в'їхати прямо в поїзд, перебуваючи в режимі FSD».

За словами Доті, він намагався повідомити про те, що сталося, і знайти схожі випадки, але не знайшов адвоката, який погодився б прийняти його справу, тому що він не отримав значних травм — лише біль у спині та забій.

Компанія Tesla застерігає водіїв від використання системи FSD за поганого освітлення або поганих погодних умов, таких як дощ, сніг, прямі сонячні промені та туман, які можуть значно погіршити роботу.

Це пов'язано з тим, що погана видимість заважає роботі датчиків Tesla, які включають ультразвукові датчики, що використовують високочастотні хвилі для відображення від прилеглих об'єктів. Також використовують радарні системи, які випромінюють низькі частоти світла, щоб визначити, чи є поблизу автомобіль, і 360-градусні камери. Всі ці системи збирають дані про навколишній простір, включаючи дорожні умови, інтенсивність руху та прилеглі об'єкти, але в умовах поганої видимості вони не можуть точно визначити обстановку навколо.

На питання, чому він продовжував використовувати систему FSD після першого близького зіткнення, Доті відповів, що вірив у її правильну роботу, оскільки протягом деякого часу у нього не виникало жодних інших проблем.

«Використовуючи систему FSD без проблем протягом деякого часу, ви починаєте довіряти її правильній роботі, як і у випадку з адаптивним круїз-контролем, - сказав він. — Ви вважаєте, що автомобіль сповільниться при наближенні до автомобіля, що йде попереду, поки він раптом цього не зробить і вам не доведеться раптово брати керування на себе. Така самовпевненість може з часом розвинутися через те, що система зазвичай працює як слід, тому подібні збої викликають особливу тривогу».

У керівництві Tesla водіїв попереджають про те, що не слід сліпо довіряти лише FSD. Необхідно постійно тримати руки на кермі, «пам'ятати про дорожні умови та навколишній рух, звертати увагу на пішоходів та велосипедистів і завжди бути готовими до негайних дій».

Систему автопілота Tesla звинувачують у тому, що вона спричинила страшну аварію, в якій загинув чоловік з Колорадо, який їхав додому з поля для гольфу, згідно з позовом, поданим 3 травня. Сім'я Ханса фон Охайна стверджує, що 16 травня 2022 року він користувався системою автопілота Tesla Model 3 2021 року випуску, коли автомобіль різко звернув праворуч з дороги, але Ерік Россітер, який був пасажиром, каже, що в момент аварії водій перебував у стані сильного алкогольного. сп'яніння. Охайн спробував повернути контроль над автомобілем, але не зміг і загинув, коли машина зіткнулася з деревом і спалахнула. Пізніше розтин показав, що у момент смерті допустима норма алкоголю у його організмі перевищили втричі.

У 2019 році чоловік із Флориди також загинув, коли автопілот Tesla Model 3 не встиг загальмувати. Внаслідок цього автомобіль потрапив під причіп і водій загинув миттєво.

У жовтні минулого року Tesla виграла свій перший позов у зв'язку зі звинуваченнями в тому, що функція автопілота призвела до загибелі чоловіка з Лос-Анджелеса, коли Model 3 з'їхала з шосе та врізалася у пальму, після чого спалахнула.

Адміністрація безпеки дорожнього руху (NHTSA) провела розслідування ряду аварій, пов'язаних із функцією автопілота, та заявила, що ДТП сприяла «слабка система залучення водія». Ця функція «привела до передбачуваного неправильного використання та аварій, яких можна було уникнути», йдеться у звіті NHTSA, і додається, що система не «достатньо забезпечувала увагу водія та належне використання».

У грудні Tesla випустила оновлення програмного забезпечення для двох мільйонів автомобілів у США, яке мало покращити роботу систем автопілота та FSD, але тепер, у світлі нових аварій, NHTSA припустила, що цього оновлення було недостатньо.

Ілон Маск не прокоментував звіт NHTSA, але раніше він стверджував, що люди, які використовують функцію автопілота, в середньому вдесятеро рідше потрапляють в аварії.

«Люди гинуть через помилкову довіру до можливостей автопілота Tesla. Навіть прості кроки можуть підвищити безпеку, - сказав телеканалу CNBC Філіп Купман, дослідник автомобільної безпеки та професор комп'ютерної інженерії в Університеті Карнегі-Меллон. — Tesla могла б автоматично обмежувати використання автопілота призначеними для нього дорогами на основі картографічних даних, які вже є в автомобілі. Також Tesla могла б покращити моніторинг, щоб водії не могли регулярно занурюватись у свої мобільні телефони під час роботи автопілота».